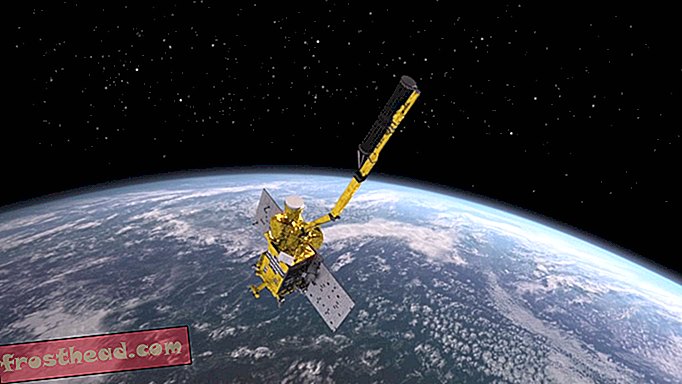

Tehisintellekt on R2-D2-st peale jõudnud kaugele. Tänapäeval kaotaks nutikate GPS-süsteemideta enamus aastatuhandeid. Robotid juba navigeerivad lahinguväljal ja droonid võivad peagi toimetada Amazoni pakette meie koduuksele.

Siri saab lahendada keerulisi võrrandeid ja öelda teile, kuidas riisi keeta. Ta on isegi tõestanud, et suudab küsimustele isegi huumorimeelega vastata.

Kuid kõik need edusammud sõltuvad sellest, kas kasutaja annab AI suuna. Mis juhtuks, kui GPS-seadmed otsustaksid, et nad ei taha keemiliste puhastusvahendite juurde minna, või mis veelgi hullem, Siri otsustas, et temast saab nutikam ilma teieta?

Meie viimane leiutis: tehisintellekt ja inimkonna ajastu lõpp. "> Meie lõplik leiutis: tehisintellekt ja inimkonna ajastu lõpp. ">" Enne kui jagame planeedi ülintelligentsete masinatega, peame nende mõistmiseks välja töötama teaduse. Vastasel juhul võtavad nad kontrolli alla, "räägib autor James Barrat oma uuest raamatust" Meie lõplik leiutis: tehisintellekt ja inimkonna lõpp " (James Barrati viisakus)

Meie lõplik leiutis: tehisintellekt ja inimkonna ajastu lõpp. ">" Enne kui jagame planeedi ülintelligentsete masinatega, peame nende mõistmiseks välja töötama teaduse. Vastasel juhul võtavad nad kontrolli alla, "räägib autor James Barrat oma uuest raamatust" Meie lõplik leiutis: tehisintellekt ja inimkonna lõpp " (James Barrati viisakus) Need on kõige vaiksemad tulemused, autor ja dokumentaalfilmide autor James Barrat ennustab oma uues raamatus " Meie lõplik leiutis: tehisintellekt ja inimkonna lõpp" .

Varsti, enam kui kaua, väidab Barrat, tehisintellekt - alates Siri-st kuni droonide ja andmekaevandamise süsteemideni - lõpetab inimeste uuenduste otsimise ja hakkab juba iseseisvalt parendusi otsima. Ja erinevalt ulme R2-D2-st ja HAL-ist, ei ole meie tuleviku AI tingimata sõbralikud. Tema sõnul võivad need tegelikult olla need, mis meid hävitavad.

Lühidalt, kas saate selgitada oma suurt ideed?

Sellel sajandil loovad teadlased intelligentsusega masinaid, mis on võrdsed ja ületavad siis meie oma. Kuid enne, kui jagame planeedi ülintelligentsete masinatega, peame nende mõistmiseks välja töötama teaduse. Vastasel juhul võtavad nad kontrolli alla. Ja ei, see pole ulme.

Teadlased on juba loonud masinad, mis on malest paremad kui inimesed, Jeopardy!, navigeerimine, andmete kaevandamine, otsing, teoreemi tõestamine ja lugematu arv muid ülesandeid. Lõpuks luuakse masinaid, mis on paremad kui inimesed AI uurimisel

Sel ajal saavad nad oma võimeid väga kiiresti parandada. Need enesetäiendavad masinad täidavad seatud eesmärke - olgu need kosmoseuuringud, malemäng või varude korjamine. Edu saavutamiseks otsivad ja kulutavad nad ressursse, olgu selleks energia või raha. Nad püüavad vältida rikkerežiime, näiteks välja- või väljalülitamist. Lühidalt öeldes arendavad nad draive, sealhulgas enesekaitset ja ressursside hankimist - draive, mis sarnanevad meie omadega. Nad ei kõhkle kerjama, laenama, varastama ja mis veel hullem, et vajalikku saada.

Kuidas teid see teema huvitas?

Olen dokumentaalfilmide tegija. 2000. aastal küsitlesin leiutaja Ray Kurzweili, robotist Rodney Brooksit ja sci-fi legendi Arthur C. Clarke'i TLC-filmi kohta, mis käsitles romaani ja filmi, 2001: A Space Odyssey. Intervjuudes uuriti Hal 9000 ideed ja pahatahtlikke arvuteid. Kurzweili raamatutes on kujutatud AI tulevikku vägivaldse „singulaarsusena” - perioodina, mil tehnoloogilised edusammud ületavad inimese võime neid mõista. Ometi ootas ta AI-st ilmnevaid vaid häid asju, mis on piisavalt tugevad, et inimese intelligentsust sobitada ja ületada. Ta ennustab, et suudame oma keha rakke haiguse ja vananemise vastu võitlemiseks ümber programmeerida. Me arendame nanobotide abil ülitugevust, mis annavad rohkem hapnikku kui punased verelibled. Laadime oma ajud arvutiimplantaatidega üle, nii et muutume intelligentseks. Ja me kanname oma ajud vastupidavamale andmekandjale kui meie praegune „märgvara” ja elame igavesti, kui tahame. Brooks oli optimistlik ja nõudis, et AI-ga täiustatud robotid oleksid liitlased, mitte ähvardused.

Teadlaseks muudetud autor Clarke seevastu oli pessimistlik. Ta ütles, et luure võidab välja ja inimesed konkureerivad tõenäoliselt ellujäämise nimel ülivõimsate masinatega. Ta ei olnud konkreetne selles osas, mis juhtub, kui jagame planeeti ülitarkade masinatega, kuid ta leidis, et see oleks inimkonna võitlus, mida me ei võida.

See läks vastuollu kõigega, mida ma AI kohta olin mõelnud, nii et hakkasin tehisintellekti eksperte küsitlema.

Milliseid tõendeid peate oma idee toetamiseks?

Täiustatud tehisintellekt on kahesuguse kasutusega tehnoloogia, näiteks tuuma lõhustumine, mis on võimeline tekitama suurt kahju või suurt kahju. Me alles hakkame kahju nägema.

NSA privaatsuskandaal tekkis seetõttu, et NSA töötas välja väga keerukad andmete kaevandamise tööriistad. Agentuur kasutas oma jõudu miljonite telefonikõnede ja kogu Interneti metaandmete - kriitiliselt kogu e-posti - vähendamiseks. Andmekaevandamise AI võimu all kuritarvitas amet põhiseaduse kaitsmiseks usaldatud ametit. Nad arendasid tööriistad, mis on vastutustundlikuks kasutamiseks liiga võimsad.

Täna algab järjekordne eetiline võitlus täisautomaatsete AI-st inspireeritud täiesti autonoomsete tapja droonide ja lahinguvälirobotite valmistamise eest, mis on inimtapjad ilma silmuses olevate inimesteta. See on kaitseministeeriumi ja droonide ning robotite tootjate vahel, kellele DOD maksab, ja inimeste vahel, kes arvavad, et arukate tapmismasinate loomine on rumal ja ebamoraalne. Autonoomsete droonide ja lahinguvälirobotite pooldajad väidavad, et nad on moraalsemad - st vähem emotsionaalsed, sihivad paremini ja on distsiplineeritumad kui inimoperaatorid. Inimesed, kes keelduvad inimeste silmusest eemaldamisest, vaatavad droonide õnnetut tsiviilelanike tapmise ajalugu ja seotust ebaseaduslike mõrvadega. Kes kannab moraalse süüd, kui robot tapab? Kas robotite tegijad, robotikasutajad või mitte keegi? Ärge kunagi jälitage tehnilisi tõkkeid, et teatada sõbrale vaenlast.

Pikemas perspektiivis, nagu väidavad minu raamatu eksperdid, ei saa inimese tasemel luurele lähenevat AI hõlpsasti kontrollida; kahjuks ei tähenda ülluure intelligentsust. Nagu AI teoreetik Eliezer Yudkowsky MIRI-st [masinluure uurimisinstituut] ütleb: “AI ei armasta sind ega vihka, aga sa oled tehtud aatomitest, mida ta saab kasutada millekski muuks.” Kui eetika ei suuda Kui me ehitame masinasse, siis loome üliarukaid psühhopaate, moraalsete kompassideta olendeid ja me pole kaua nende meistrid.

Mis on teie mõtlemises uut?

Nii mitmekesised isikud ja rühmad nagu Ameerika arvutiteadlased Bill Joy ja MIRI on juba ammu hoiatanud, et meil on palju karta masinate pärast, mille intelligentsus varjab meie oma. Meie lõplikus leiutises väidan, et AI-d kasutatakse ka inimliku intelligentsuse arendamisel. Tänase päeva ja päeva vahel, mil teadlased loovad inimese tasemel luureandmeid, on meil AI-ga seotud vigu ja kriminaalseid rakendusi.

Miks pole rohkem tehtud või mida tehakse selleks, et AI ei lülitaks meid sisse?

Põhjust pole üks, vaid palju. Mõned eksperdid ei usu, et oleme piisavalt lähedal inimliku tehisintellekti loomisele ja kaugemalegi, et muretseda selle riskide pärast. Paljud AI-tegijad võidavad lepinguid Kaitse edasijõudnute uurimisprojektide agentuuriga [DARPA] ega taha tõstatada küsimusi, mida nad peavad poliitiliseks. Normaalhälve on kognitiivne kallutus, mis takistab inimesi reageerimast katastroofidele ja katastroofidele nende valmistamisel - see on kindlasti selle osa. Kuid paljud AI tegijad teevad midagi. Tutvuge MIRI-d nõustavate teadlastega. Ja veelgi enam osaleb pärast seda, kui arenenud AI ohud jõuavad tavapärasesse dialoogi.

Kas saate kirjeldada hetke, kui teadsite, et see on suur?

Meie, inimesed, juhime tulevikku mitte sellepärast, et oleksime kiireimad või tugevaimad olendid planeedil, vaid sellepärast, et oleme kõige targemad. Kui jagame planeedi endaga nutikamate olenditega, juhivad nad tulevikku. Kui ma sellest mõttest aru sain, tundsin, et kirjutan meie aja kõige olulisemast küsimusest.

Igal suurel mõtlejal on eelkäijad, kelle töö oli tema avastuse jaoks ülioluline. Kes andis teile aluse oma idee üles ehitamiseks?

AI riskianalüüsi alused töötasid välja matemaatik IJ Good, ulmekirjanik Vernor Vinge ja teised, sealhulgas AI arendaja Steve Omohundro. Täna on MIRI ja Oxfordi Inimkonna Tuleviku Instituut selle probleemiga tegelemisel peaaegu üksi. Meie lõplikul leiutisel on umbes 30 lehekülge lõppmärkusi, millega neid mõtlejaid tunnustatakse.

Mis on olnud teie idee uurimisel ja arendamisel? Ja madal punkt?

Kõrgpunktid olid meie lõpliku leiutise kirjutamine ja minu pidev dialoog AI loojate ja teoreetikutega. Inimesed, kes programmeerivad AI-d, on ohutusprobleemidest teadlikud ja soovivad aidata kaitsemeetmete väljatöötamisel. Näiteks tegeleb MIRI „sõbraliku” AI loomisega

Arvutiteadlane ja teoreetik Steve Omohundro on propageerinud “tellingute” lähenemisviisi, mille puhul tõestatavalt ohutu AI aitab luua järgmise põlvkonna AI, et tagada ka selle ohutus. Siis see AI teeb sama jne. Arvan, et tuleb luua avaliku ja erasektori partnerlus, et tuua AI-tegijad kokku, et jagada mõtteid turvalisuse kohta - näiteks Rahvusvahelise Aatomienergiaagentuuri moodi, kuid koostöös ettevõtetega. Madalamad punktid? Mõistes, et relvade loomisel kasutatakse parimat ja kõige arenenumat AI-tehnoloogiat. Ja need relvad pöörduvad lõpuks meie vastu.

Millised kaks või kolm inimest proovivad teie väidet kõige tõenäolisemalt ümber lükata? Miks?

Leiutaja Ray Kurzweil on arenenud tehnoloogiate peaarst. Minu kahes temaga tehtud intervjuus väitis ta, et me segame AI tehnoloogiaid kognitiivsete täiustuste abil. Kurzweil ja inimesed, keda üldiselt nimetatakse transhumanistideks ja singularitariantideks, arvavad, et AI ja lõpuks ka tehislik üldintellekt ja väljaspool seda arenevad koos meiega. Näiteks suurendavad arvutiimplantaadid meie aju kiirust ja üldisi võimeid. Lõpuks arendame välja tehnoloogia oma luure ja teadvuse arvutitesse viimiseks. Siis on ülluure vähemalt osaliselt inimlik, mis teoreetiliselt tagaks ülluure "turvalise".

Mitmel põhjusel ei ole ma selle vaatepunkti fänn. Probleem on selles, et meil, inimestel, ei ole usaldusväärset turvalisust ja tundub, et ka ülitarkadest inimestest ei saa. Meil pole aimugi, mis juhtub inimese eetikaga pärast tema intelligentsuse suurendamist. Meil on agressiooniks bioloogiline alus, mis masinatel puudub. Üliluure võib väga hästi olla agressiooni kordistaja.

Keda see idee kõige rohkem mõjutab?

Ülimalt intelligentsete masinate reguleerimata arendamise tõttu on kõigil planeedil palju karta. Praegu toimub luurevõistlus. AGI saavutamine on Google, IBM ja paljude väiksemate ettevõtete, näiteks Vicarious ja Deep Thought, aga ka DARPA, NSA ning valitsuste ja ettevõtete välismaal töökoht number üks. Kasum on selle võistluse peamine motivaator. Kujutage ette ühte tõenäolist eesmärki: virtuaalne inimaju arvuti hinnaga. See oleks ajaloo kõige tulusam kaup. Kujutage ette panku tuhandetest doktorikraadiga ajudest, mis töötavad ööpäevaringselt farmaatsiatoodete arendamise, vähiuuringute, relvade arendamise ja palju mujal. Kes ei tahaks seda tehnoloogiat osta?

Samal ajal arendab 56 riiki lahinguväljas roboteid ning nende ja droonide autonoomseks muutmise eesmärk on. Need on masinad, mis tapavad ilma inimeste järelvalveta. Vaesunud rahvaid saavad kõige rohkem kahjustada autonoomsed droonid ja lahinguvälirobotid. Esialgu saavad ainult rikkad riigid lubada autonoomset tapmisrobotit, nii et rikkad riigid kannavad neid relvi vaesunud riikide inimsõdurite vastu.

Kuidas see võib muuta elu, nagu me seda teame?

Kujutage ette: juba kümne aasta pärast on pool tosinat ettevõtet ja riiki arvutid, mis konkureerivad või ületavad inimese intelligentsust. Kujutage ette, mis juhtub, kui neist arvutitest saab nutikate arvutite programmeerimise ekspert. Varsti jagame me planeeti masinatega tuhandeid või miljoneid kordi intelligentsemaid kui me oleme. Ja kogu aeg relvastatakse selle tehnoloogia iga põlvkond. Reguleerimata on see katastroofiline.

Millistele küsimustele jäetakse vastuseta?

Lahendused. Ilmne lahendus oleks masinatele moraalse mõistuse andmine, mis paneb nad inimelu ja vara väärtustama. Kuid eetika masinasse programmeerimine osutub äärmiselt raskeks. Moraalinormid erinevad kultuuriti, nad muutuvad aja jooksul ja on kontekstuaalsed. Kui me, inimesed, ei jõua elu algul kokkuleppele, siis kuidas saaksime masinale elu kaitsmiseks öelda? Kas me tõesti tahame olla ohutud või tahame tõesti olla vabad ? Me võime seda arutada kogu päeva ega jõua üksmeelele. Kuidas saaksime seda siis programmeerida?

Samuti, nagu ma varem mainisin, peame AI arendajad kokku võtma. 1970ndatel otsustasid rekombinantse DNA teadlased uuringud katkestada ja asuda kokku konverentsil Californias Pacific Grove'is Asilomaris. Nad töötasid välja põhilised ohutusprotokollid, nagu näiteks “ärge jälgige DNA-d teie kingadel”, kartuses keskkonda saastada käimasolevate geneetiliste töödega. Asilomari juhiste tõttu on maailm kasu geneetiliselt muundatud põllukultuuridest ja geeniteraapia tundub paljutõotav. Nii palju kui teada, õnnestus õnnetusi vältida. Aeg on AI jaoks Asilomari konverents

Mis seisab ees?

Tohutu majandustuul ajab arenenud AI-taseme intelligentsuse välja töötama arvuti hinnaga, mis on ajaloo kuumim kaup. Google ja IBM ei soovi oma saladusi avalikkuse ega konkurentidega jagada. Kaitseministeerium ei soovi avada oma laboreid Hiinasse ja Iisraeli ja vastupidi. Üldsuse teadlikkus peab ajendama poliitikat avatuse ning avaliku ja erasektori partnerluse suunas, mis on kavandatud ohutuse tagamiseks.

Mis on teie jaoks järgmine?

Olen dokumentaalfilmide tegija, nii et muidugi mõtlen filmi Meie lõplik leiutis filmiversioonile.